Στις αρχές της δεκαετίας του 1960, μια εποχή κατά την οποία η τεχνητή νοημοσύνη βρισκόταν ακόμη στα πρώτα της βήματα, ο καθηγητής Joseph Weizenbaum ανέπτυξε ένα πρωτοποριακό υπολογιστικό πρόγραμμα με το όνομα ELIZA.

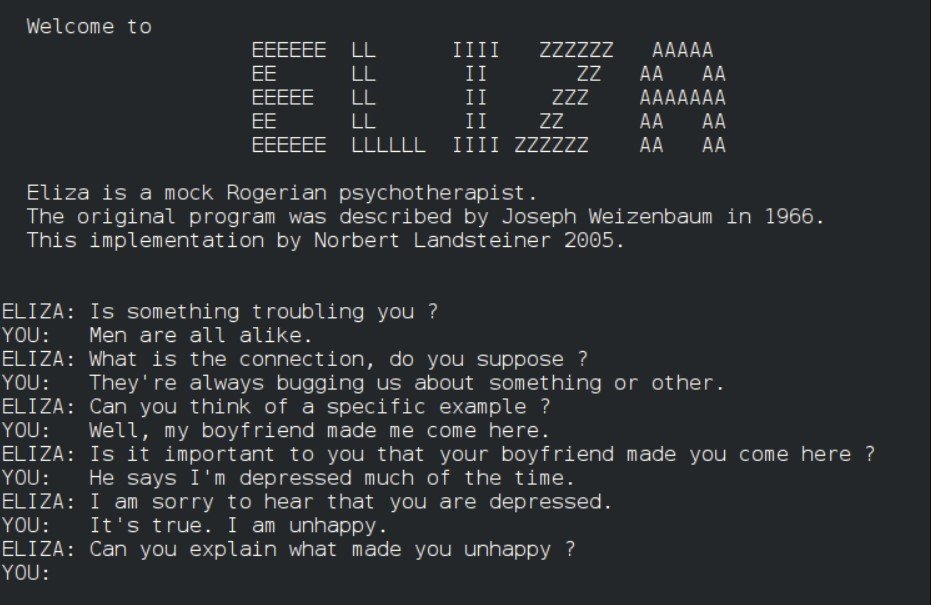

Το 1966, ένας καθηγητής του MIT ονόματι Joseph Weizenbaum δημιούργησε το πρώτο chatbot. Του έδωσε αρχικά τον ρόλο ενός ψυχοθεραπευτή. Ο χρήστης πληκτρολογούσε ένα μήνυμα σε μια ηλεκτρική γραφομηχανή συνδεδεμένη με έναν κεντρικό υπολογιστή. Μετά από λίγο, ο «ψυχοθεραπευτής» απαντούσε.

Χρήστης: Όλοι οι άντρες είναι ίδιοι.

Chatbot: ΜΕ ΠΟΙΟΝ ΤΡΟΠΟ;

Χρήστης: Πάντα μας ενοχλούν για το ένα ή το άλλο.

Chatbot: ΜΠΟΡΕΙΣ ΝΑ ΣΚΕΦΤΕΙΣ ΕΝΑ ΣΥΓΚΕΚΡΙΜΕΝΟ ΠΑΡΑΔΕΙΓΜΑ;

Ο Weizenbaum δημοσίευσε αυτό το δείγμα διαλόγου σε ένα άρθρο περιοδικού που εξηγούσε πώς λειτουργούσε το όλο σύστημα. Ονόμασε το πρόγραμμα Eliza, από την Eliza Doolittle στο έργο «Πυγμαλίων». Το πρόγραμμα αυτό αποτέλεσε ένα από τα πρώτα παραδείγματα λογισμικού που μπορούσε να προσομοιώσει την συζήτηση με έναν άνθρωπο.

Ουσιαστικά, ήταν ένα πρωτόγονο chatbot, το οποίο λειτουργούσε μέσω ενός συστήματος αναγνώρισης προτύπων και αντικατάστασης φράσεων. Η πιο γνωστή «προσωπικότητα» της ELIZA ήταν αυτή τουψυχοθεραπευτή, εμπνευσμένου από τις θεωρίες του Carl Rogers. Στο πλαίσιο αυτό, η ELIZA δεν έδινε απαντήσεις με βάση λογική κατανόηση ή ψυχολογική ανάλυση, αλλά απλώς επανέγραφε τα λόγια του χρήστη, μετατρέποντάς τα σε ερωτήσεις ή επισημάνσεις που ενθάρρυναν τη συνέχεια της συνομιλίας.

Για παράδειγμα, αν ένας χρήστης έλεγε: «Η μητέρα μου με ανησυχεί πολύ», η ELIZA θα μπορούσε να απαντήσει: «Πες μου περισσότερα για τη μητέρα σου».

Προκάλεσε σάλο στην εποχή της

Η Eliza προκάλεσε σάλο στην εποχή της – η εφημερίδα Boston Globe έστειλε έναν δημοσιογράφο να καθίσει μπροστά από τη γραφομηχανή και δημοσίευσε ένα απόσπασμα της συνομιλίας – και παραμένει μία από τις πιο γνωστές εξελίξεις στην ιστορία της πληροφορικής.

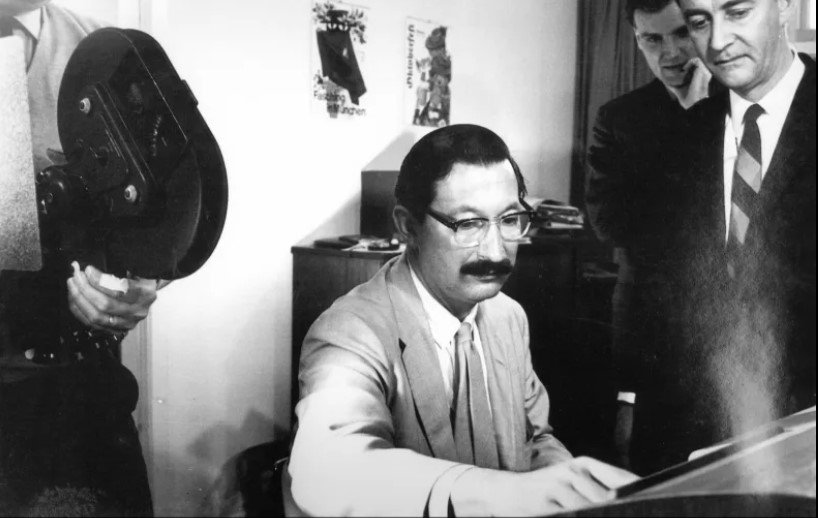

Ο ίδιος ο Βάιζενμπάουμ ήταν ένας από τους σημαντικότερους πρωτοπόρους της τεχνητής νοημοσύνης, αλλά και ένας από τους πρώτους που άσκησαν έντονη κριτική στις δυνατότητες και τα όρια της. Γεννήθηκε το 1923 στο Βερολίνο, σε μια εβραϊκή οικογένεια, και αναγκάστηκε να μεταναστεύσει στις Ηνωμένες Πολιτείες το 1936, εξαιτίας της ανόδου του ναζισμού. Εκεί σπούδασε μαθηματικά και πληροφορική, και σταδιοδρόμησε στον τομέα των υπολογιστών.

Καθώς οι υπολογιστές έχουν γίνει πιο ισχυροί, το «Φαινόμενο Eliza» έχει γίνει ακόμα πιο έντονο. Ας πάρουμε για παράδειγμα τον τρόπο με τον οποίο πολλοί άνθρωποι σχετίζονται με το ChatGPT. Μέσα στο chatbot υπάρχει ένα «μεγάλο γλωσσικό μοντέλο», ένα μαθηματικό σύστημα που έχει εκπαιδευτεί να προβλέπει την επόμενη σειρά χαρακτήρων, λέξεων ή προτάσεων σε μια ακολουθία. Αυτό που διακρίνει το ChatGPT δεν είναι μόνο η πολυπλοκότητα του μεγάλου γλωσσικού μοντέλου που το υποστηρίζει, αλλά και η παράξενη φωνή του που μοιάζει με ανθρώπινη. Όπως έχει πει ο Colin Fraser, επιστήμονας δεδομένων στη Meta, η εφαρμογή είναι «σχεδιασμένη για να σας ξεγελάσει, να σας κάνει να πιστεύετε ότι μιλάτε με κάποιον που δεν είναι πραγματικά εκεί».

Αλλά το φαινόμενο Eliza δεν είναι ο μόνος λόγος για να επιστρέψουμε στον Weizenbaum. Η εμπειρία του με το λογισμικό ήταν η αρχή ενός αξιοσημείωτου ταξιδιού. Ως καθηγητής του MIT με μια λαμπρή καριέρα, ήταν, σύμφωνα με τα δικά του λόγια, «ιερέας, αν όχι επίσκοπος, στον καθεδρικό ναό της σύγχρονης επιστήμης». Ωστόσο, μέχρι τη δεκαετία του 1970, ο Joseph Weizenbaum είχε γίνει αιρετικός, δημοσιεύοντας άρθρα και βιβλία που καταδίκαζαν την κοσμοθεωρία των συναδέλφων του και προειδοποιούσαν για τους κινδύνους που ενέχει το έργο τους. Η τεχνητή νοημοσύνη, κατέληξε να πιστεύει, ήταν «δείκτης της παραφροσύνης του κόσμου μας».

Η προσκόλληση με τον Φρόιντ

Στην αρχή της καριέρας του, ο Σίγκμουντ Φρόιντ παρατήρησε ότι οι ασθενείς του συνεχώς ερωτεύονταν τον ίδιο. Κατέληξε στο συμπέρασμα ότι αυτό δεν οφειλόταν στο ότι ήταν εξαιρετικά γοητευτικός ή όμορφος. Αντίθετα, συνέβαινε κάτι πιο ενδιαφέρον: η έννοια της μεταβίβασης, η τάση μας να προβάλλουμε συναισθήματα για κάποιον από το παρελθόν μας σε κάποιον στο παρόν μας. Αν και ενισχύεται από την ψυχανάλυση, είναι ένα χαρακτηριστικό όλων των σχέσεων. Τα απομεινάρια της προηγούμενης ζωής μας, και πάνω απ' όλα της παιδικής μας ηλικίας, είναι η οθόνη μέσω της οποίας βλέπουμε ο ένας τον άλλον.

Αυτή η έννοια βοηθά να κατανοήσουμε τις αντιδράσεις των ανθρώπων απέναντι στην Eliza. Ο Weizenbaum είχε ανακαλύψει τυχαία την ηλεκτρονική εκδοχή της μεταβίβασης, με τους ανθρώπους να αποδίδουν κατανόηση, ενσυναίσθηση και άλλα ανθρώπινα χαρακτηριστικά σε ένα λογισμικό. Αν και ο ίδιος δεν χρησιμοποίησε ποτέ τον όρο, είχε μακρά ιστορία με την ψυχανάλυση, η οποία επηρέασε σαφώς τον τρόπο με τον οποίο ερμήνευσε αυτό που θα γινόταν γνωστό ως «φαινόμενο Eliza».

Το αξιοσημείωτο δεν ήταν η τεχνική πολυπλοκότητα του προγράμματος – στην πραγματικότητα, ήταν αρκετά απλό – αλλά το πώς οι άνθρωποι αντέδρασαν σε αυτό. Πολλοί χρήστες ανέπτυξαν συναισθηματικούς δεσμούς με το πρόγραμμα, νιώθοντας ότι "τους καταλάβαινε". Ακόμη και εκπαιδευμένοι επαγγελματίες εντυπωσιάστηκαν από την ψευδαίσθηση της κατανόησης που δημιουργούσε η ELIZA. Αυτό το φαινόμενο – της τάσης να αποδίδουμε ανθρώπινα χαρακτηριστικά σε άψυχα αντικείμενα ή προγράμματα – ονομάστηκε αργότερα «ELIZA effect».

Ο Joseph Weizenbaum αρχικά αντιμετώπισε το έργο του ως ένα επιστημονικό πείραμα, ένα εργαλείο για την κατανόηση της ανθρώπινης συμπεριφοράς απέναντι στην τεχνολογία. Δεν είχε την πρόθεση να δημιουργήσει μια πραγματική εφαρμογή ψυχοθεραπείας ή να υποκαταστήσει τον ανθρώπινο διάλογο. Όμως, καθώς η ELIZA κέρδιζε αναγνώριση και οι χρήστες της άρχισαν να της αποδίδουν περισσότερο βάθος και κατανόηση απ’ ό,τι πραγματικά διέθετε, ο Weizenbaum άρχισε να ανησυχεί σοβαρά.

Η στιγμή της κρίσιμης καμπής ήρθε όταν η γραμματέας του, αφού δοκίμασε το πρόγραμμα, του ζήτησε να αποχωρήσει από το δωμάτιο ώστε να συνεχίσει τη "συνομιλία" της με την ELIZA ιδιωτικά. Αυτό το περιστατικό φώτισε στον Weizenbaum μια ανησυχητική αλήθεια: οι άνθρωποι ήταν διατεθειμένοι να αποκαλύψουν προσωπικά τους δεδομένα και συναισθήματα σε ένα άψυχο, ανόητο μηχάνημα, μόνο και μόνο επειδή η συνομιλία τους "έμοιαζε" με αυτήν ενός ευαίσθητου ανθρώπινου ακροατή.

Αυτό τον οδήγησε σε μια βαθύτερη φιλοσοφική και ηθική ανασκόπηση του έργου του. Αντί να δει το δημιούργημά του ως μια τεχνολογική επιτυχία, άρχισε να το αντιμετωπίζει ως ένα παράδειγμα των κινδύνων της Τεχνητής Νοημοσύνης, ιδίως όταν η κοινωνία δεν κατανοεί επαρκώς τα όριά της. Ο Weizenbaum ανησυχούσε ότι τέτοια προγράμματα θα μπορούσαν να χρησιμοποιηθούν όχι για να υπηρετήσουν τον άνθρωπο, αλλά για να χειραγωγήσουν ή να υποκαταστήσουν ουσιώδεις ανθρώπινες σχέσεις, όπως η εμπιστοσύνη, η ενσυναίσθηση και η επικοινωνία.

Το 1976 δημοσίευσε το βιβλίο του "Computer Power and Human Reason: From Judgment to Calculation" στο οποίο εξέφρασε τις βαθιές του ανησυχίες για τη μηχανική σκέψη και την αυτοματοποίηση της ανθρώπινης κρίσης. Σε αυτό το έργο, ο Weizenbaum αποκήρυξε ευθέως την ELIZA, δηλώνοντας ότι παρόλο που είχε δημιουργήσει το πρόγραμμα, ήταν εντελώς αντίθετος με τη χρήση της ΤΝ για την αντικατάσταση ανθρώπινων λειτουργιών όπως η φροντίδα, η ηθική κρίση και η συναισθηματική υποστήριξη.

Κατά τη γνώμη του, η ανθρώπινη σκέψη και ηθική δεν μπορούν να αναχθούν σε υπολογιστικούς κανόνες ή μαθηματικά μοντέλα. Η επιμονή των επιστημόνων να δημιουργήσουν "σκεπτόμενες μηχανές" έκρυβε, σύμφωνα με τον ίδιο, μια επικίνδυνη αλαζονεία: την πεποίθηση ότι η ανθρώπινη συνείδηση, η ηθική και η ενσυναίσθηση είναι απλές διαδικασίες που μπορούν να αναπαραχθούν από αλγορίθμους.

Καθώς οι δεκαετίες περνούσαν και η τεχνητή νοημοσύνη άρχισε να διεισδύει σε ολοένα και περισσότερους τομείς – από την υγεία και τη δικαιοσύνη, μέχρι την εκπαίδευση και την ψυχαγωγία – η φωνή του Weizenbaum έγινε ακόμα πιο επίκαιρη. Προειδοποίησε για τους κινδύνους της τεχνολογικής αποξένωσης, δηλαδή της απομάκρυνσης των ανθρώπων από τους συνανθρώπους τους μέσω της υπερβολικής εξάρτησης από μηχανές. Κατά τη γνώμη του, η τεχνολογία όφειλε να υπηρετεί τον άνθρωπο, όχι να τον αντικαθιστά σε ουσιώδεις πτυχές της ανθρώπινης ύπαρξης.

Ο Weizenbaum δεν ήταν τεχνοφοβικός – αντιθέτως, ήταν πρωτοπόρος στους υπολογιστές και τη γλώσσα προγραμματισμού – αλλά θεωρούσε ότι η τεχνολογία πρέπει να συνοδεύεται από ηθική ευθύνη. Η αντίδρασή του απέναντι στο ίδιο του το δημιούργημα δεν ήταν άρνηση της προόδου, αλλά μια έκκληση για αυτοσυγκράτηση και κριτική σκέψη απέναντι στις δυνατότητες της τεχνητής νοημοσύνης.

Η πιο γνωστή του δημιουργία είναι το πρόγραμμα ELIZA, το οποίο ανέπτυξε το 1966. Το πρόγραμμα αυτό προσομοίωνε έναν ψυχοθεραπευτή, συνομιλώντας με τον χρήστη με βάση προκαθορισμένους κανόνες. Παρόλο που το ELIZA δεν καταλάβαινε πραγματικά τη γλώσσα, πολλοί χρήστες πίστεψαν ότι είχαν απέναντί τους έναν «σκεπτόμενο» υπολογιστή. Αυτή η αντίδραση του κόσμου έκανε τον Βάιζενμπάουμ να ανησυχήσει σοβαρά.

Στα επόμενα χρόνια, στράφηκε ενάντια στη χρήση της τεχνητής νοημοσύνης για σκοπούς που απαιτούν ανθρώπινη κρίση, ηθική και συναισθηματική κατανόηση. Στο βιβλίο του Computer Power and Human Reason (1976), υποστήριξε ότι οι μηχανές δεν μπορούν και δεν πρέπει να υποκαθιστούν τον άνθρωπο σε κρίσιμους ρόλους, όπως στην ιατρική, στην ψυχολογία ή στη λήψη πολιτικών αποφάσεων.

Το 1988, αποσύρθηκε από το MIT. Στις αρχές της δεκαετίας του 1990, η δεύτερη σύζυγός του, Ruth, τον άφησε. Το 1996, επέστρεψε στο Βερολίνο, την πόλη από την οποία είχε φύγει 60 χρόνια νωρίτερα. «Μόλις επέστρεψε στη Γερμανία, φαινόταν πολύ πιο ευτυχισμένος και αφοσιωμένος στη ζωή», είπε ο Pm. Εκεί βρήκε τη ζωή πιο εύκολη. Καθώς η φήμη του ξεθωριάζε στις ΗΠΑ, αυξανόταν στη Γερμανία. Έγινε δημοφιλής ομιλητής, γέμιζε αίθουσες διαλέξεων και έδινε συνεντεύξεις στα γερμανικά.

Ο Weizenbaum δεν απέκλεισε ποτέ την πιθανότητα να αναπτυχθεί κάποια μέρα νοημοσύνη σε έναν υπολογιστή. Αλλά αν συνέβαινε αυτό, είπε στον συγγραφέα Daniel Crevier το 1991, θα ήταν «τουλάχιστον τόσο διαφορετική όσο η νοημοσύνη ενός δελφινιού από αυτή ενός ανθρώπου».

Ο Weizenbaum στα τελευταία του χρόνια ήταν όλο και πιο απαισιόδοξος για το μέλλον, πολύ περισσότερο από ό,τι ήταν στη δεκαετία του 1970. Η κλιματική αλλαγή τον τρομοκρατούσε. Ωστόσο, διατηρούσε την ελπίδα για τη δυνατότητα ριζικής αλλαγής.

Όπως έγραψε σε ένα άρθρο του τον Ιανουάριο του 2008 για την Süddeutsche Zeitung: «Η πεποίθηση ότι η επιστήμη και η τεχνολογία θα σώσουν τη Γη από τις επιπτώσεις της κλιματικής κατάρρευσης είναι παραπλανητική. Τίποτα δεν θα σώσει τα παιδιά και τα εγγόνια μας από μια γήινη κόλαση. Εκτός αν οργανώσουμε την αντίσταση ενάντια στην απληστία του παγκόσμιου καπιταλισμού». Δύο μήνες αργότερα, στις 5 Μαρτίου 2008, ο Weizenbaum πέθανε από καρκίνο του στομάχου. Ήταν 85 ετών.

Η κληρονομιά του «ELIZA» είναι διπλή: από τη μια πλευρά, αποτελεί ιστορικό ορόσημο στην εξέλιξη των chatbot και της ανθρώπινης-υπολογιστικής αλληλεπίδρασης. Από την άλλη, αποτελεί και σύμβολο προειδοποίησης: ένα έργο που ο ίδιος ο δημιουργός του αποκήρυξε, ακριβώς επειδή έγινε μάρτυρας του τρόπου με τον οποίο οι άνθρωποι μπορούν να εξαπατηθούν από την ψευδαίσθηση της κατανόησης και της ενσυναίσθησης εκ μέρους μιας μηχανής.

Στον σημερινό κόσμο, όπου η τεχνητή νοημοσύνη γίνεται όλο και πιο προηγμένη, το παράδειγμα της ELIZA και η στάση του Joseph Weizenbaum παραμένουν εξαιρετικά επίκαιρα. Μας υπενθυμίζουν ότι, όσο εξελιγμένοι κι αν είναι οι αλγόριθμοι, η ηθική κρίση, η αλληλεγγύη και η ανθρώπινη συναισθηματική νοημοσύνη δεν μπορούν – και δεν πρέπει – να ανατεθούν σε μηχανές.